Bonjour !

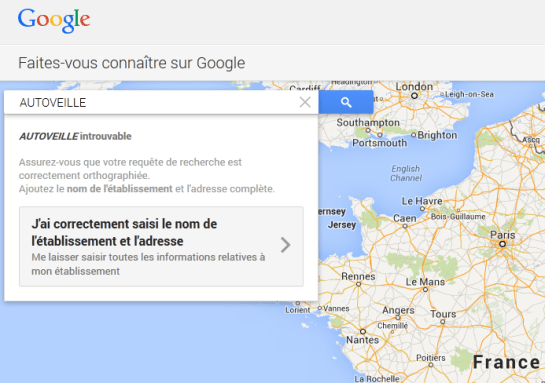

J’étais en train de développer un flux RSS pour mon site AUTOVEILLE afin de relayer les dernières informations sur mon logiciel de veille, et je ne pensais pas écrire sur le SEO et les mots-clés en (not provided).

Mais …, entre temps, en effectuant ma veille stratégique, je suis tombée sur un article parlant (encore !) de ce « problème » de sécurisation des mots-clés, et j’ai eu l’idée de vous présenter quelques outils alternatifs qui permettraient de savoir plus ou moins comment les internautes arrivent sur votre site.

1) Le premier que je regarderais est : Google Webmaster Tools

Pour voir les mots-clés sur lesquels internautes sont arrivés, il faut aller dans Trafic de recherches > Requêtes de recherche > Filtrer sur « Tous« . Vous verrez ensuite une liste de mots-clés avec leurs taux d’impressions, les clics, leurs CTR, les positionnements de votre site sur ces derniers :

2) Le deuxième outil que j’utliserais : Google Keyword Planner

Même si les statistiques ne sont pas très précises, cet outil permet quand même de nous donner une idée sur la popularité d’un mot-clé. Remplissez bien les champs, définissez bien le ciblage, et ajoutez votre page de destination aussi. Cela vous donnera des mots encore plus ciblés :

3) Le troisième outil serait Google Trends !

Cet outil permet de voir en un œil la tendance des recherches pour un mot-clé par période, par région. Il vous indique aussi les mots-clés les plus fréquents qui sont recherchés 🙂 Cela donne vraiment des pistes intéressantes :

J’aime bien Google Trends pour ma part, peut être encore plus que le Keyword Planner, parce qu’ils proposent plus de fonctionnalités et on voit l’évolution d’une expression-clé dans le temps ! Très important 😉

4) Le quatrième outil, je dirais qu’il faut regarder les suggestions de Google et le nombre de résultats donnés pour un mot-clé. Plus il y a de pages indexées sur ce mot-clé, plus il y aurait de la concurrence sur ce mot.

Voilà, à peu près ce que je peux vous dire pour aujourd’hui. Je pense qu’avec l’algorithme Colibri, il est intéressant d’utiliser Google Trends pour repérer l’évolution d’un mot-clé dans le temps, et s’il est toujours recherché.

J’espère que cet article vous aurait rassurés, moi, en l’écrivant, je me dis que le (not provided) pourrait être embêtant, mais il ne va pas « tuer » le SEO.

Et vous ? Auriez-vous d’autres suggestions d’outils ?

Courage ! 😉

Véronique Duong –