Bonjour à tous !

Ce nouvel article ne va pas proposer de tests techniques ou de développements d’outils de veille ou de SEO, mais juste refléter quelques pensées que j’ai par rapport au Big Data.

Je vais parler de deux problématiques qui me reviennent souvent à l’esprit dès que je veille ou que je lis des articles sur le Big Data.

- Comment récupérer au maximum les données présentes (bases de données, webanalytics, CRM ou GRC) pour bien connaître ses visiteurs, ses internautes ?

- Comment faire pour bien définir une stratégie marketing (proposition personnalisée de produits, retargeting, etc.) très personnalisée ?

Par rapport à la collecte, cela dépend de la stratégie marketing que vous voulez mettre en place. Si on prend l’exemple de la vente des produits, ça serait utiliser le Big Data pour redéfinir une meilleure stratégie de vente. Il faudrait se tourner vers les bases de données PHP, SQL (type OVH déjà) où on peut par exemple récupérer les données (coordonnées, autres informations) sur les utilisateurs, leurs commentaires pour ensuite les analyser attentivement.

Il faut faire des groupes d’utilisateurs, car tous les produits que l’on vend, ne sont pas forcément dédiés tout public. Plus un produit est ciblé et correspond aux attentes, mieux c’est. Cependant, il y a des contraintes quant à la collecte des données. On ne peut pas toujours tout récupérer.

Voici les plus gros challenges auquel le Big Data pour le Marketing doit faire face :

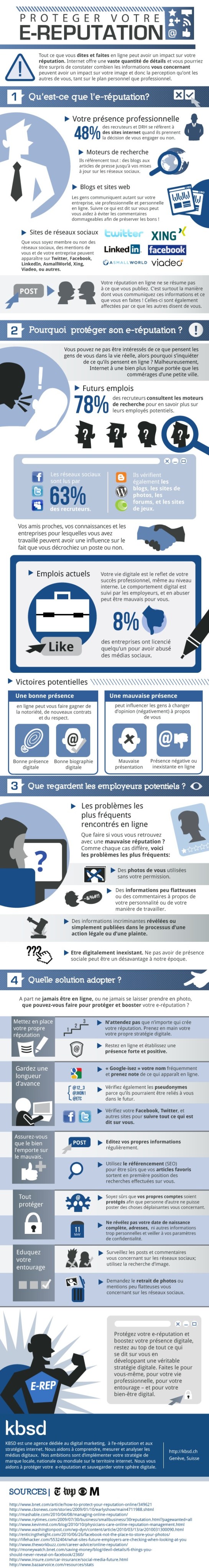

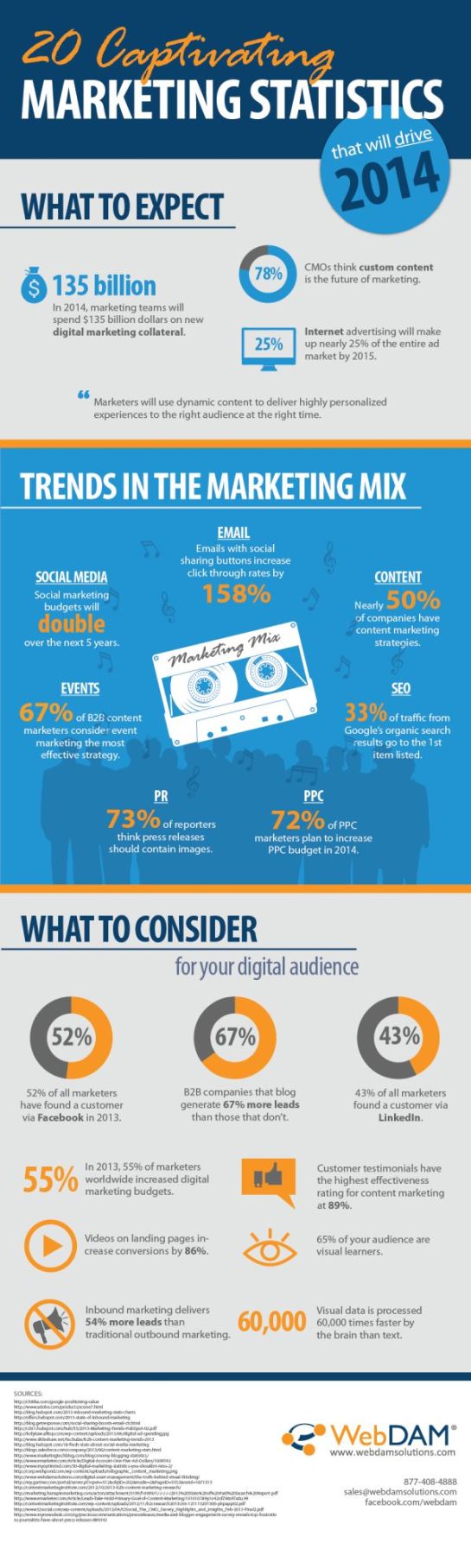

Certaines entités ont trop peu de clients pour se constituer une base, certaines collectent irrégulièrement les données et pas assez en temps-réel, le manque de partage des données est un frein pour mesurer correctement le retour sur investissement de la stratégie marketing, et surtout … 45% des entités n’utilisent pas correctement les données des clients / consommateurs pour personnaliser leurs stratégies de communication ! Je trouve cela vraiment dommage.

Cependant, cette petite infographie date de 2012, et les chiffres auraient légèrement évoluer depuis (avec toutes les sensibilisations qu’on a sur le web, on aurait plus de sociétés qui optimisent cela).

Je pense que les sociétés et les entreprises devraient mieux exploiter leurs données clientèles pour proposer des services plus adaptés à chaque consommateur. Il y a certes de l’investissement au début, mais si c’est pour bien améliorer le ROI, cela en vaut la peine.

Si vous êtes SEO à la base, je vous conseille de lire cet article sur le remarketing de Moz. Cela m’a fait beaucoup réfléchir en parallèle sur le sujet du Big Data.

Je suis prête à discuter avec vous sur le sujet du Big Data qui m’intéresse autant que la veille et le SEO ! Email : autoveille@free.fr

Merci beaucoup

Véronique Duong –