Bonjour tout le monde !

Comme vous le savez tous, de formation, je suis ingénieure linguiste, et je suis autant passionnée par le TAL que par le SEO. Je dirais toujours que c’est le TAL qui m’a menée vers le SEO car j’ai vu le lien entre ces deux domaines dès le début : Linguistique x Informatique en TAL, et Sémantique x Technique en SEO. Je me définirais toujours comme une spécialiste du SEO et du Traitement Automatique des Langues. Il y a moins d’événements sur le TAL que le SEO, et je trouve cela extrêmement dommage car le TAL, la science du langage a tout le mérite de se faire connaître.

En TAL, on produit des outils, des scripts qui servent, qui sont utiles pour des expériences scientifiques, et cela permet de faire progresser la R&D pour beaucoup de choses. Typiquement, j’utilise mes compétences en TAL pour automatiser certaines phases super chronophages (nettoyage des textes, optimisation des méta tags, etc.). autant que possible.

Pendant ce HackaTAL 2017 qui s’est déroulé à Orléans, au Lab’O (incubateur de start-ups dans le numérique), on a eu droit à quelques petites conférences d’entreprises spécialisées dans le TAL, telles que Recital (génération de résumé automatique), Mood Messenger, etc.

On avait des tâches très précises à réaliser, et voici les consignes officielles :

Tâches

1. Résumé automatique de commentaires sur des produits en ligne

Objectifs

Dans le cadre de la promotion de produits sur les plateformes en ligne, l’appréciation peut être analysée à partir des retours utilisateurs (User Generated Content). Ces derniers peuvent se présenter : notes, étoiles, mais aussi avis et commentaires textuels. Les notes n’étant pas toujours en adéquation avec les contenus textuels, de plus en plus d’acteurs cherchent à qualifier l’opinion des utilisateurs et à déterminer quels sont leurs arguments.

La thématique est orientée sur les avis et commentaires concernant l’offre de logements en région centre (particuliers, auberges, hôtels, luxe, etc.). Il s’agira de construire un résumé automatique des commentaires, à partir des arguments détectés dans ces derniers, à comparer aux notes et/ou à la description. Ce résumé orienté devra être séparé en deux champs principaux : points positifs et points négatifs sur des critères communs : accueil, confort, services, propreté, accessibilité, etc. D’autres champs peuvent être proposés par les participants selon les arguments extraits à partir des commentaires.

Sous tâches

- Traitement / débruitage de données UGC

- Détection et extraction d’arguments

- Agrégation des valeurs par produits

- Détection et résolution de contradictions

- Résumé automatique d’opinions sur les aspects

Données et évaluation

Collection de données représentant chaque produit en ligne (champs de description du produit, notes ou étoiles, liste des commentaires associés) en français et en anglais. Les données seront fournies sous-forme de corpus (pour le corpus collecté sur Internet) et/ou via des liens à télécharger (pour les données fournies par les partenaires, à préciser).

L’évaluation portera sur la capacité à calculer automatiquement les scores pour chaque catégorie d’évaluation du produit (accueil, propreté, emplacement, etc.). Pour chacun de ces scores, un argumentaire résumé automatiquement devra être fourni qui pourra faire l’objet d’évaluation qualitatives.

2. Identification des tendances stratégiques liées aux brevets

Objectifs

La stratégie de dépôt de brevets par des entreprises ou des individus représente un enjeu considérable, qui a donné lieu à des affaires mondialement connues (Apple vs Samsung, Microsoft vs Google). Cet outil juridique reste cependant difficilement accessible pour les entreprises de petite taille ou les individus. En particulier, il n’est pas évident de déterminer quelles technologies vont avoir tendance à être l’objet de brevets, dans une optique de veille ou de préservation de la propriété intellectuelle.

La tâche proposée vise à mieux modéliser les mécanismes qui permettent de prédire l’apparition de brevets pour des technologies en essor, par utilisation de méthodes d’IA et de TAL (terminologie et expressions multi-mots, catégorisation des brevets, évolution des termes et des n-grams, prédiction de tendances). L’objectif est de déterminer, au regard des données collectées sur des brevets (par ex. distribution des termes entre 2001 et 2009), quels brevets seront déposés (par ex. en 2010). Pour illustration : si “tactile” est recensé avec une grande montée en 2010, pouvait-on prédire cette montée en exploitant les données de la décennie précédente ?

Sous tâches

- Prétraitement du langage et de la structure des brevets

- Extraction de terminologies liées aux technologies

- Comparaison des termes des brevets avec les sites technologiques

- Détection de signaux faibles

- Analyse et prédiction de tendances

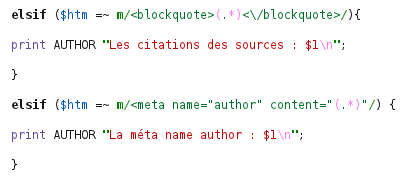

De mon côté, je me suis penchée sur le résumé automatique de commentaires sur des produits en ligne. J’ai déjà eu des sujets similaires à traiter, et je trouve cela plus concret et utilisable tout de suite derrière (une fois que le script est prêt, l’outil peut servir !! 🙂 ) On était une équipe de 3 : deux développeurs web et moi. La technologie utilisée était du PHP, des Regex, de l’étiquetage de données, et la stratégie était d’utiliser les mots ayant le plus de poids dans une phrase (adverbe, adjectifs, verbes). Avec cette méthode, on a eu un Rappel de près de 80% ! (Rappel = le nombre de documents correctement retrouvé dans sa classe, Précision = le nombre de documents correctement attribué dans sa classe (ex : pour le rappel, cela veut dire que le commentaire a bien été retrouvé dans telle ou telle catégorie automatiquement, et la précision correspond au fait si le commentaire est bien attribué positif / neutre / négatif).

C’est mon équipe qui a gagné le HackaTAL 2017 !!! Je suis très contente que ma stratégie / réflexion marche (avec les ADJ, les ADV, etc.), et on s’est bien débrouillé avec les développeurs ! Un Grand MERCI à Nicolas Le Flohic et Fanny Jan, mes co-équipiers.

Voici quelques clichés du HackaTAL 2017 :

La jolie photo de souvenirs devant le logo du Lab’O !

Présentations des projets de chaque équipe :

Ca code, ça code !! Près de 48 heures de scripting 😉

https://twitter.com/eldams/status/878903996307693569

https://twitter.com/eldams/status/878902768886579200

Toutes les équipes ont bien travaillées, et ce sont données à 200% !!! Un week-end intense avec de belles rencontres, des échanges hyper intéressants, et … cela m’a redonnée une folle envie de me remettre dans le TAL !!

En tout cas, une chose est sûr, la Science du Langage est une science qui a beaucoup d’avenir :

Je pense qu’il y a moyen qu’un jour, je retourne à 100% dans les Sciences du Langage, dans le Traitement Automatique des Langues. On verra ce que la vie me donnera !

J’espère que cet article vous aura plu, il change un peu du SEO 😉

Un énorme merci à Damien Nouvel (ERTIM / INALCO), au Lab’O et tous ceux qui ont organisé cet superbe événement concret et intense !

Bon courage à tous,

Véronique Duong – Ingénieure Linguiste … avant tout 🙂 !